Фильтр за качество страниц и семантики

Нужна помощь в продвижении сайта?

Падение на 20-30 пунктов в Яндекс. Продолжение истории с НКС, про которую уже много тут писали.

В этой статье ты найдешь информацию о массовом падении сайтов весной 2021 года и как спасать ситуацию. История, кстати массовая. И лекарство уже есть.

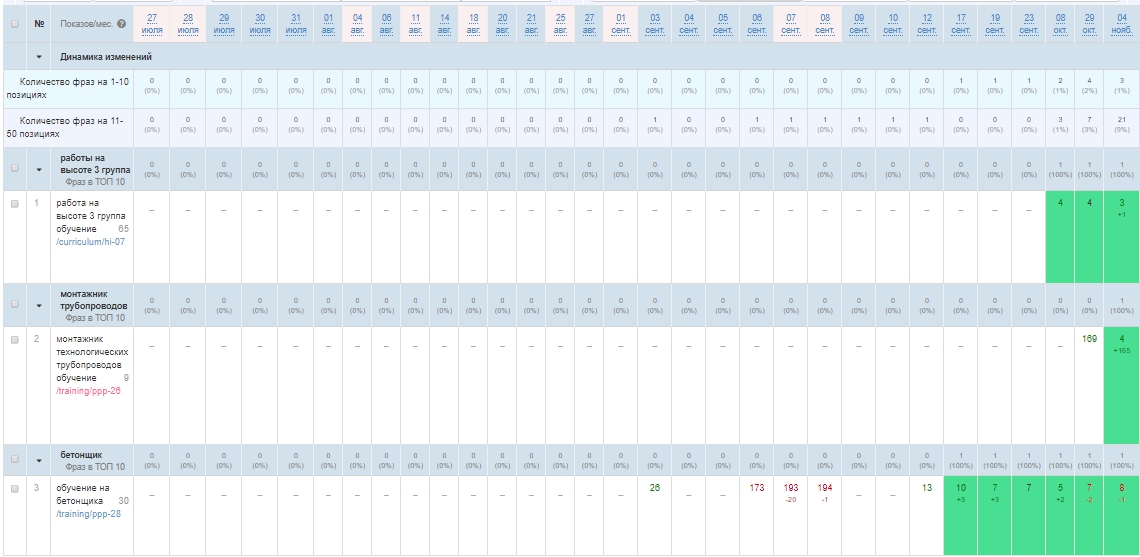

С каждым днем все больше и больше сайтов, излеченных этим методом и вот как это выглядит, чтобы не быть голословным (скрины в слайдере ниже можно листать влево-вправо):

Некоторые из вас даже могли видеть кейс в блоге ТОПвизора, написанный одним из участников моего ЗSС

Предыстория:

Начнем с предыстории:

Яндекс затягивает одну и ту же гайку на протяжении последних четырех лет.

Эта гайка связана, в сути своей, с дорвейством и бесконечной генерацией искусственной семантики в рамках сайта.

Началось все с SEO фильтра и искусственной семантики в Директ.

Виток 1: SEO фильтр и искусственная семантика

О да, в свое время SEO фильтр работал божественно)) И, конечно же, сеошники и Директологи начали этим злоупотреблять.

И гайку затянули. И затянули очень серьезно и жестко. Теперь раскрытым SEO фильтром, перемножающим все на все, мы просто убивали карму домена под ноль, без возможности реабилитации (только переклейка домена помогает)

Далее правильные сеошники начали собирать самую полную, качественную семантику и внедрять на сайт, но они злоупотребляли тем тезисом, что уникальность ни в рамках интернета, ни в рамках сайта особой роли не играла

Виток 2: уникальность соседних страниц

И гайку вновь закрутили! И это привело к появлению в Мае 2020 года логики НКС в Яндекс.

Тут все просто – это проблема неуникальных соседних страниц в рамках сайта.

Далее мы начали следить за уникальностью страниц друг относительно друга и качеством их наполнения.

Виток 3: качество семантики в рамках сайта

Но гайку вновь затянули! В Марте-Апреле 2021 гайку нам затянули еще туже. И те сайты, которые имели на себе большое число страниц, созданных под нулевую и даже околонулевую семантику начали тонуть.

Тут лекарство так же оказалось простым – необходимо пересобрать семантику для сайта, склеив тоненькие и слабенькие веточки с мамками, либо закрыв от индексации.

Это так же довольно массовая ситуация с сайтами на вордпресс, где картинки попадают в индекс поиска. Особенность сайтов на вордпресс в том, что под картинку создается отдельный URL, который состоит только из этой картинки. И таких страниц могут быть тысячи. Естественно, что никакой семантики под такими страницами нет. И сайты на вордпресс, где этот каталог картинок попал в индекс массово и дружно валятся в бездну. После закрытия от индексации этого каталога начинается рост. Только в последние пару месяцев на моей памяти вылечили так 8 сайтов на Вордпресс.

Алгоритм работы:

Ниже ты найдешь пошаговый алгоритм работы по спасению сайта, просевшего в Яндекс по всем направлениям на 20-30 пунктов:

В общем и целом, борьба со слабыми страницами имеет следующий алгоритм:

Это вопрос к наполненности страниц — на сайте не должно быть пустых или полупустых страниц, которые уходят в индекс. Пустые страницы вполне себе могут существовать и на них даже можно лить рекламу при желании, но они не должны попадать в индекс поисковой системы.

H1 должен являть собой маркер – основной запрос кластера (если это не так – подбираем маркеры для каждой страницы)

*Алгоритм до боли похож на историю с Гугл, которая была описана в моем паблике 2 года назад — помните? Гугл Фред?!

Как итог – на сайте не должно остаться страниц, неуникальных друг относительно друга, недостаточно наполненных и страниц со слабой семантикой, либо без семантики и взрослых страниц без трафика.

Для товаров интернет-магазинов тут все несколько сложнее, сегодня вдаваться в подробности не буду, поэтому товары можете не трогать.

КЛЮЧЕВОЙ МОМЕНТ!

Недостаточно качественные страницы в «Яндексе»: что это значит и что с ними делать?

В статье расскажем, как найти недостаточно качественные страницы на сайте и как они влияют на поисковое продвижение. Рассмотрим причины, по которым алгоритмы «Яндекса» удаляют их из поиска. Дадим рекомендации для успешной борьбы с ними.

При работе с сайтом оптимизаторы могут обнаружить страницы, которые «Яндекс» определил как низкокачественные (НКС). Поисковая система посчитала их бесполезными, поэтому не показывает в выдаче. Перед тем как рассмотреть причины этого и рассказать о способах, как исправить ситуацию, разберёмся с поиском НКС на своём ресурсе.

Ищем некачественные страницы

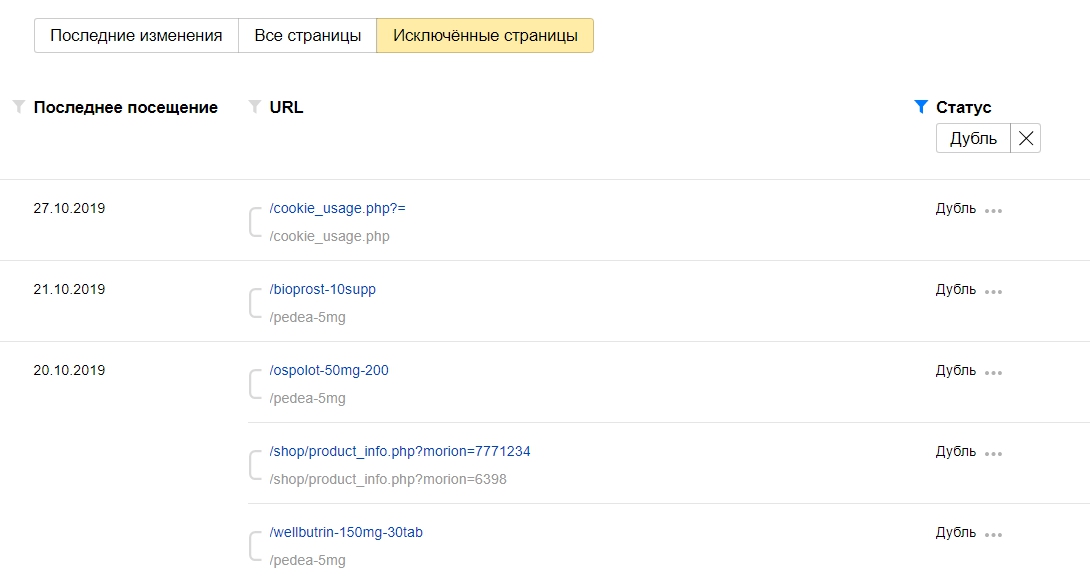

Найти недостаточно качественные страницы можно в «Яндекс.Вебмастере». Введите адрес сайта, кликните на раздел «Индексирование», в выпадающем меню выберите пункт «Страницы в поиске». Вы попадёте в раздел, где возможно отследить изменения в индексации. Выберите вкладку «Исключённые страницы» и пункт «Недостаточно качественная». На запрос «Вебмастер» сгенерирует список ссылок на страницы низкого качества. Линки кликабельны – легко перейти в документ и работать с ним. Полученный перечень возможно скачать в Excel, в конце списка есть специальные кнопки.

Влияние на продвижение

На практике у оптимизаторов по этому поводу складывается другое мнение. Поисковые боты «выставляют» усреднённую оценку всему сайту: чем больше некачественных разделов, тем ниже оценивается ресурс в целом. Большое количество НКС снижает доверие к веб-площадке и отражается на ранжировании – возможно понижение позиций в выдаче, даже по трафикогенерирующим запросам.

Одним словом, не стоит оставлять без внимания недостаточно качественные страницы, т.к. они в любом случае не приносят пользы SEO-продвижению. Но и паниковать не нужно, просто выясните причину и постарайтесь устранить.

Причины статуса НКС и что с ними делать

Основная причина, по которой «Яндекс» посчитал страницу низкокачественной, – бесполезность для пользователей, нерелевантность запросам. Точную работу алгоритма знают только разработчики, но оптимизаторы отмечают, что статус «некачественные» обычно получают разделы со следующими проблемами :

В низкокачественные могут попасть служебные документы: карта сайта, добавление в корзину, RSS-ленты. Но они и не должны показываться в выдаче, поэтому такой статус для них нестрашен. Просто закройте их в robots.txt или тегом nofollow.

Как предупредить появление НКС?

В завершении статьи расскажем, как сделать, чтобы низкокачественных страниц было меньше:

Теперь вы знаете, что такое недостаточно качественные страницы и что с ними делать. Но также важно понимать: алгоритмы постоянно меняются и дорабатываются, поэтому не пугайтесь, если десятки веб-страниц резко стали некачественными. Такое случается, иногда стоит немного подождать, чтобы всё вернулось на место. Если этого не происходит, ищите проблему и устраняйте. Работайте над сайтом, делайте его интересным и удобным для посетителей, улучшайте функционал, и тогда, скорее всего, проблем не возникнет.

Почему Яндекс «не видит» мой сайт?

В понятие «не видит» может быть вложено разное поведение поисковика. В статье разберём, что делать, когда состояние сайта не оправдывает вложенные в него силы и средства.

Есть несколько ситуаций, которые люди описывают как «не видит».

Сайт совсем не индексируется поисковой системой. Проблема актуальна для новых сайтов и старых. Например, вы вносите изменения на страницы, но по прошествии нескольких текстовых апов Яндекса ситуация с позициями не меняется, а текстовая копия страницы в Яндексе остаётся прежней. Здесь нужно в первую очередь смотреть на технические ошибки. Далее в статье рассмотрим, на чём нужно сфокусировать внимание, чтобы исключить влияние технических факторов.

Более сложное решение и более сильные аналитические навыки нужны в ситуации, когда страницы нормально и регулярно индексируются, но позиции не улучшаются.

С таким могут сталкиваться и новые, и старые сайты. Проблема сохраняется, даже если на сайт постоянно вносятся изменения, проводится регулярная работа над контентом, дорабатывается и улучшается функционал, но Яндекс игнорирует ваши старания. Здесь нет точного рецепта, кроме комплексного анализа.

Отсутствует движение в позициях на протяжении нескольких месяцев. Для молодых сайтов это может быть большой проблемой, так как чаще всего только после 3–6-месячного периода активных работ НЧ запросы начнут занимать хотя бы ТОП-50.

Исключаем технические причины

В процессе поиска причин, почему Яндекс не ранжирует ваш сайт, нужно в первую очередь исключить проблему с индексированием.

Как убедиться в наличии/отсутствии страницы/сайта в индексе:

Лучше использовать все методы в комплексе, чтобы убедиться, что страница действительно не в индексе.

Как бороться с проблемой:

Нужно исключить все технические препятствия для нормальной индексации.

Проверьте robots.txt

В файле может быть закрыт весь сайт/раздел/страница.

Примеры запрещающих директив:

Disallow: / # закрыт сайт

Disallow: /products/ # закрыт раздел

Disallow: /diabet_plast.html # закрыта страница

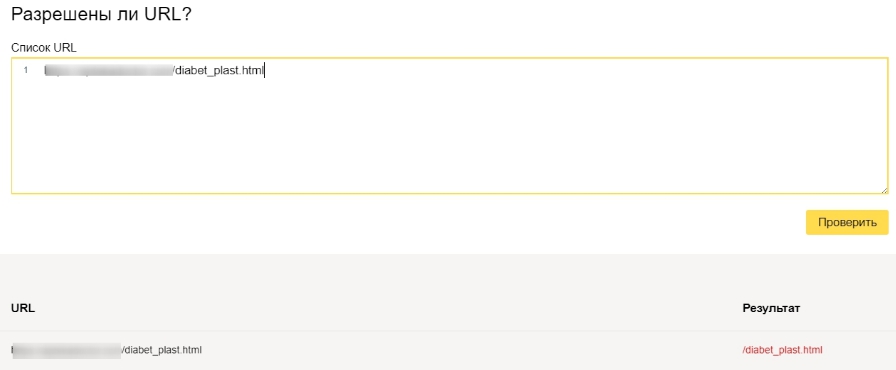

Проверять файл на наличие правил, запрещающих индексирование, лучше через инструмент в Яндекс.Вебмастере «Анализ robots.txt».

На скриншоте ниже показан результат проверки страницы на предмет доступности роботам в файле robots.txt.

Дубли

Если проблема не с целым сайтом, а всего лишь с одним или несколькими его важными документами, то причина может крыться в наличии дублей. Часто у страницы может просто быть дубль – страница с таким же содержанием, которая либо автоматически создана несовершенствами админки, либо умышленно (но редко встречается).

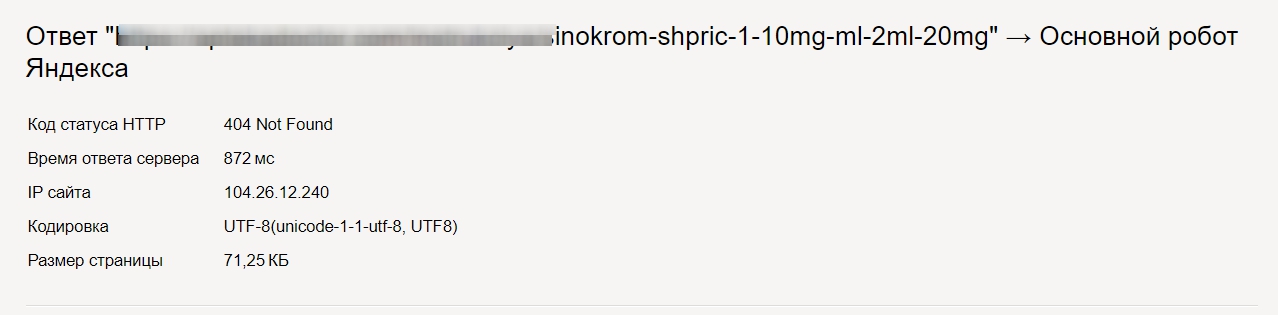

Некорректный ответ сервера

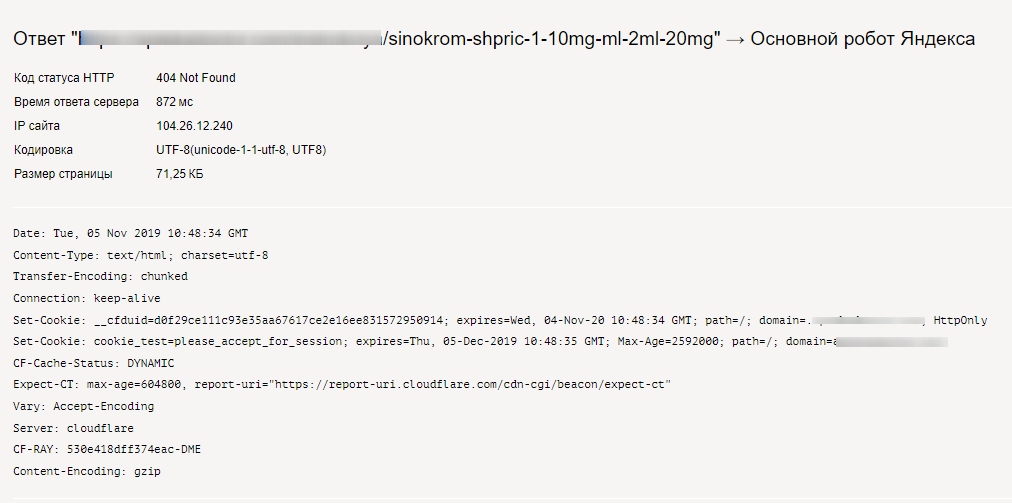

Здесь речь даже не о стандартных случаях, когда у сайта проблемы с доступностью, то есть вы видите реальную 404-тую страницу, вместо главной, или частые уведомления о 5**-тых ошибках. А о том, что визуально сайт работает, но на самом деле сервер отдаёт 404-тый код поисковому роботу. Такие неочевидные ошибки можно выявить через инструмент «Проверка ответа сервера» в панели Яндекс.Вебмастера.

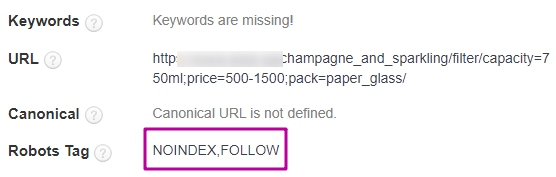

Запрещающие метатеги

Метатеги носят строгий характер для поисковых роботов, поэтому вам стоит тщательно проверить код неиндексируемых страниц на наличие таких конструкций:

Проверять наличие запрета можно через плагин, например, SEO Meta in 1 Click

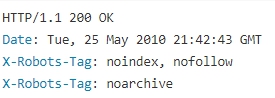

HTTP-заголовоки X-Robots-Tag

В http-ответах сервера могут передаваться запрещающие заголовки.

Существует масса инструментов для проверки ответа сервера и передаваемых в нём заголовков. Один из таких сервисов bertal.ru или тот же «Проверка ответа сервера» в панели для вебмастеров от Яндекса.

Здесь нужно проверять log-файлы сайта и анализировать, какие роботы посещают страницу. Как удобно анализировать log-файлы при помощи Power BI читайте в нашей статье.

Несовершенства внутренней оптимизации

Фильтр

Сайт зафильтрован: чаще всего он в индексе, но не получает ожидаемого трафика. Здесь нужно проверять предупреждения в разделе «Диагностика» – «Безопасность и нарушения».

Если фильтр автоматический, то уведомлений в Вебмастере не будет. Выявить его можно только примерно. Определить, наложен ли фильтр, может помочь наш цикл статей.

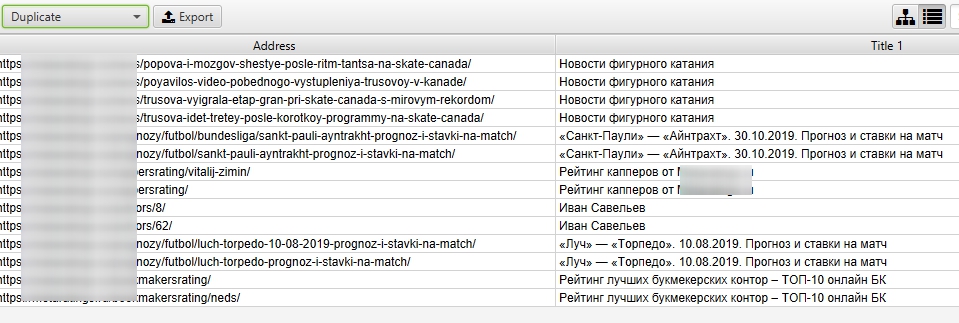

Наличие дублей

Одинаково вероятная причина плохого ранжирования как для новых, так и для старых сайтов. Наличие дублей в целом негативно влияет на оценку сайта поисковиком, путает робота, который вынужден выбирать среди нескольких документов наиболее релевантный.

Проверить наличие технических дублей можно при помощи парсинга.

Выбирайте удобный для себя парсер при помощи нашей обзорной статьи «Обзор ТОП-6 парсеров сайтов».

Увидеть проблему с дублями можно в разделе «Страницы в поиске» – «Исключённые страницы» – фильтр «Дубли».

Неуникальный контент

Проблема с позициями может возникать, если ваш сайт повторяет контент других сайтов. Когда информационный ресурс не содержит добавочной ценности и намерен просто занимать место на серверах поисковиков, то у Яндекса нет оснований предоставлять ему место в ТОПах. Подробнее о ценности уникального контента для поисковых систем в статье.

Недостаточно полная внутренняя оптимизация страницы

Внутренняя оптимизация включает в себя в первую очередь работу с количеством и характером запросов на странице.

Здесь работа должна вестись без отрыва от анализа конкурентов по выдаче.

Как выбрать конкурентов узнайте из нашей статьи – «Как найти новые точки роста поискового трафика».

После вычисления конкурентов проведите сравнительный анализ полноты внутренней оптимизации своего сайта с конкурентами.

Внимание обращайте на такие основные элементы, задающие релевантность документа: Title, H1, анкоры внутренних ссылок, Alt-текст. Сравните, насколько полно оптимизированы ваши страницы, нет ли переспама.

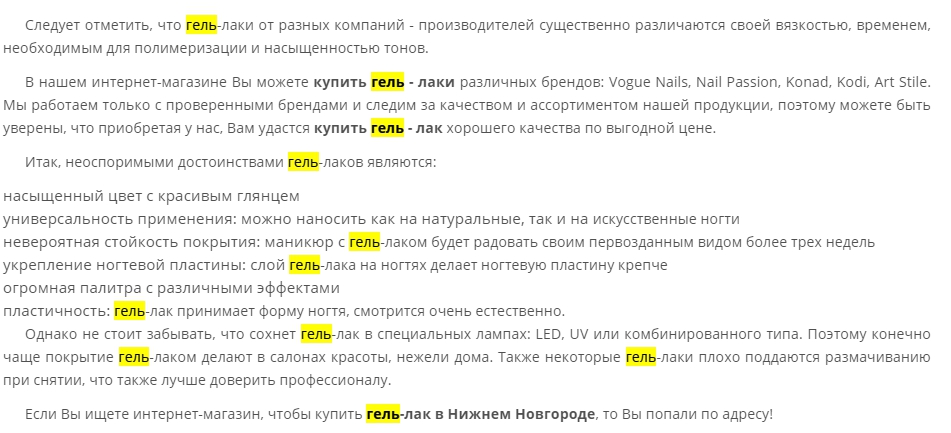

Особое внимание стоит уделить seo-текстам на категориях интернет-магазинов:

Пример спамного текста, который приводит к Бадену:

Помните, что в случае с Яндексом – от seo-текста лучше отказаться. В случае в Google – лучше согласиться на него (если он есть у конкурентов).

Некорректные данные в сохранённой копии

Проблемное ранжирование сайта может быть обусловлено тем, что поисковик не видит какой-то контент, который виден пользователю. Либо, наоборот, может содержать избыточный, дублирующийся контент.

Поэтому проверяйте сохранённую копию страницы, особенно её текстовый вариант.

На примере ниже страница, текст которой открывается через кнопку «Подробнее».

А вот как эта же страница выглядит в текстовой сохранёнке Яндекса.

То есть полный вариант текста показывается роботу дважды.

Новые сайты «не любит» Яндекс

Среди сеошного сообщества последние полгода ходит слух об аналоге «Песочницы» для новых сайтов. Суть в том, что новые сайты не ранжируются Яндексом. Что такое «не ранжируются» – не находятся даже в ТОП-500 тематики со слабой конкуренцией.

Для примера. Сайт был оптимизирован по технической части, внутренней и велись работы по внешней. Всё это не давало результата на протяжении 3 месяцев. Яндекс упорно не ранжировал сайт более чем по 200 целевым ключам.

Первые результаты появились только в середине сентября при том, что для индексации сайт был открыт ещё в июле.

То есть путь нашего целевого сайта к первым ТОПовым позициям составлял всего лишь три месяца. Но есть случаи, когда Яндекс пускает в первую десятку новые сайты только после шести месяцев. Здесь остаётся только запастись терпением и работать над комплексом факторов – внутренние, внешние, коммерческие и поведенческие. Последние особенно важны, если Яндекс использует свой алгоритм Многорукий бандит для вашего сайта.

Такая история возможна и для информационных ресурсов, и для коммерческих. В нашем примере был сайт услуг.

Выводы

Что делать, если Яндекс упорно игнорирует ваши работы над сайтом? Выжимка рекомендаций для владельцев сайтов:

Если у Вас возникли проблемы с индексацией в Яндексе, обращайтесь к нам!

Как бороться с НКС и маловостребованная страница в Яндекс? Все о SEO в 2021 году | FLSEO

В 2020 году Яндекс выкатил новый фильтр YATI для борьбы с НКС и маловостребованными страницы. Сайты с большим количеством в индексе неуникальных, похожих между собой страниц в рамках одного сайта быстро просели пунктов на 20-30 просто за один день. И вернуться в ТОП было непросто. Мало было просто найти проблему, ее необходимо было решить, уникализировать страницы в рамках одного сайта.

Ранее бытовало такое мнение, что страницы одного сайта должны быть уникальными от страниц другого сайта. При этом про уникальность страниц в рамках одного сайта никто даже не говорил. То есть все боролись за уникальность от других сайтов, но никто даже не подозревал, что проблема ближе, чем кажется. Как оказалось, уникальность контента внутри сайта имеет особую значимость.

Почему страница может быть признана малоценной или маловостребованной:

1. Контент частично или полностью дублирует другую страницу. Особенно это относится к интернет-магазинам. Карточки товаров схожи между собой в контенте, плюс уникальность уменьшается из-за сквозных блоков – шапки, подвала, меню, сайдбара.

2. Заголовки и мета-теги прописаны неправильно.

3. Контент представлен в виде изображения: внимание на организацию портфолио.

4. Контент динамический и выводится в виде JS-скриптов.

5. Контент выводится через iframe: особенно касается видео.

Робот воспринимает всю страницу целиком, со всеми сквозными блоками (шапка, меню, сайдбар, футер). Причем основная контентная область страницы, где мы размещаем контент, может занимать меньший объем документа, иногда это менее 10% от области, принимающей участие в ранжировании. И если две страницы отличаются только картинками и парой предложений, то велика вероятность, что их признают дублями. И поисковая система будет удалять эти страницы из поиска. Чем больше таких страниц, тем меньше шансов осесть в ТОП-10.

Мы должны постоянно мониторить отчеты в Яндекс Вебмастере по исключенным страницам и уделять пристальное внимание недостаточно качественным. Если такие страницы отражаются в Вебмастере, нужно понять, почему это произошло и как исправить ситуацию.

Также особое внимание необходимо уделять молодым сайтам, для которых новый фильтр стал якорем, тянущим на дно. Если новорег стартует при наличии таких страниц, то это неизбежно портит карму домена. И даже если исправить все эти страницы, то все равно попасть в индекс и в ТОП-10 будет гораздо сложнее и дольше, чем стартануть на новом домене.

Перед тем как выпустить сайт в свет, необходимо проверить весь сайт на наличие маловостребованных и неуникальных между собой страниц. Есть специальные программы, куда можно загрузить все ссылки страниц сайта и проверить их на уникальность. Возможно, это поможет сразу же решить проблему.

Технические страницы и некоторые дубли можно закрыть через файл robots.txt или через метатег noindex. Для страниц с параметрами (например, страницы сортировки) прописать rel=«canonical» или Clean-param в robots.txt.

Для страниц, которые не являются дублями нужно проверить, чтобы обязательно были различия в мета-тегах и заголовках. Для товарных карточек прописать как можно больше отличий в характеристиках. А еще на помощь приходят отзывы. Они не могут повторяться и это добавляет уникальности каждой странице.

Если вам нужна профессиональная помощь в СЕО продвижении, обращайтесь уже сегодня. Перед началом работы вам будет выдан бесплатный аудит сайта в формате скринкаста. Вы сможете посмотреть, какие есть проблемы на сайте, что еще нужно сделать, как я могу это реализовать. Пишите по контактным номерам. Буду рад вам помочь!

Услуга вывести страницы из под Яндекс фильтра НКС – недостаточно качественная страница или малоценная страница Dle #146031

Под понятием некачественная страница мы понимаем страницы, вероятность показа которых в поиске практически нулевая. По понятным причинам мы не рассказываем способы определения таких страниц, но это чёткий сигнал, что если вы хотите видеть эту страницу в поиске, то со страницей нужно что-то делать».

Чаще статус “Недостаточно качественная” получают страницы:

Возможные причины статуса “Недостаточно качественная”:

От себя хотим добавить:

Внесём немного корректив в слова представителя Яндекса: так как алгоритмы иногда дают сбой, причём в пользу сайтов, страница может занимать ТОП, а потом бесследно пропасть из выдачи.

То есть, страницы низкого качества – это документы, которые не имеют ценности, не несут новую и полезную информацию, не дают релевантный ответ на вопрос пользователя, с точки зрения поисковых систем.

Обычно эта проблема возникает с карточками товаров, всякого рода каталогами и списками.

Однако иногда проблемы и более глобального характера, когда на больших проектах вылетают из индекса 100 000 страниц трафик падает мгновенно.

Решение

В качестве ответа вы получите видео аудит в котором я подробно расскажу о том как исправить вашу ситуацию. На примере вывода из-под фильтра нескольких типовых страниц Вы будете понимать, как вывести из под фильтра абсолютно все проблемные страницы и больше туда не попадать.

Нужно для заказа:

Список некачественных страниц можно найти в Яндекс. Вебмастере, в левом меню Индексирование/Страницы в поиске: